Difference between revisions of "User:E.Stevens/toolsofthetradeedwin"

| Line 79: | Line 79: | ||

De tool die ik wil realiseren zou de kijker moeten beseffen hoe wij gezichtsuitdrukkingen kunnen gebruiken in het dagelijkse leven - want we communiceren niet alleen maar verbaal - en spelen ook een belangrijke rol om een film verhalend te ondersteunen en te versterken. Als filmmaker vind ik non-verbale communicatie zeer fascinerend in films. Een blik/gezichtsuitdrukking geeft zoveel sfeer en emotie mee aan de kijker. Er zijn voor mijn gevoel maar een aantal goede acteurs en actrices die gezichtsuitdrukkingen realistisch kunnen overbrengen. De Nederlandse film business staat vooral bekend om haar slechte acteerprestaties, voornamelijk verbaal - dialogen. In Nederland wordt de VSCD Mimeprijs uitgereikt aan acteurs of actrices die de belangrijkste bijdrage heeft geleverd aan mime in het betreffende seizoen. Het zijn acteurs en actrices die gezichtsuitdrukkingen en lichaamstaal goed gebruiken bij het acteren. | De tool die ik wil realiseren zou de kijker moeten beseffen hoe wij gezichtsuitdrukkingen kunnen gebruiken in het dagelijkse leven - want we communiceren niet alleen maar verbaal - en spelen ook een belangrijke rol om een film verhalend te ondersteunen en te versterken. Als filmmaker vind ik non-verbale communicatie zeer fascinerend in films. Een blik/gezichtsuitdrukking geeft zoveel sfeer en emotie mee aan de kijker. Er zijn voor mijn gevoel maar een aantal goede acteurs en actrices die gezichtsuitdrukkingen realistisch kunnen overbrengen. De Nederlandse film business staat vooral bekend om haar slechte acteerprestaties, voornamelijk verbaal - dialogen. In Nederland wordt de VSCD Mimeprijs uitgereikt aan acteurs of actrices die de belangrijkste bijdrage heeft geleverd aan mime in het betreffende seizoen. Het zijn acteurs en actrices die gezichtsuitdrukkingen en lichaamstaal goed gebruiken bij het acteren. | ||

| + | |||

| + | |||

=Research (English)= | =Research (English)= | ||

Revision as of 23:02, 4 January 2015

Gezichtsuitdrukkingen

Door middel van onze gelaatexpressies kunnen wij non-verbaal met elkaar communiceren. Via onze gezichtsuitdrukkingen geven wij voortdurend signalen aan elkaar. En meestal verraad het gezicht onze ware gevoelens. Volgens mij beseffen we niet hoe vaak wij onze gezichtsuitdrukkingen gebruiken. Ik ben gefascineerd op een chemie tussen twee mensen die door middel van een frons of een ander gelaatsexpressie al heel veel verteld.

Ideeën

1. Gezichtsuitdrukkingen vertaald naar filmmuziek

2. Gezichtsuitdrukkingen vertaald naar codetaal (bv. Enigma-apparaat)

Sensor

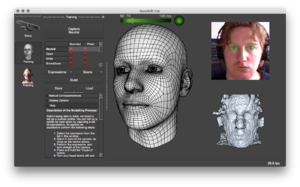

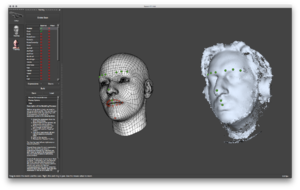

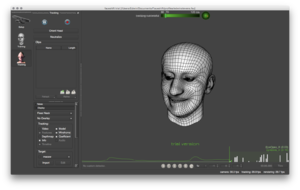

Voor het testen van mijn sensor (Kinect) maak ik gebruik van het programma Faceshift. In het programma programmeer ik verschillende gelaatsexpressies uit door met mijn gezicht te draaien voor de Kinect. Vervolgens heb ik mijn gezichtsuitdrukking gemarkt die het voorbeeldgezicht laat zien.

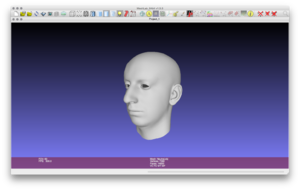

Je eigen gelaatsexpressie kan je vervolgens ook exporteren naar een 3D bestand die je, bijvoorbeeld, in Meshlab kan openen.

Research

INTRODUCTIE

De makkelijkste manier om onze gevoelens weer te geven is door middel van gezichtsuitdrukking of gelaatexpressie. Het is een communicatiemiddel waar wij dagelijks mee te maken hebben. Het versterkt en geeft meer duidelijkheid aan een verhaal. Onze emoties zijn het eerst te lezen van ons gezicht en zullen vaak onbewust getoond worden. Om gevoelens herkenbaar te maken aan andere is het niet alleen nodig dat iedereen dezelfde uitdrukkingen gebruikt, personen moeten de emoties bij andere ook herkennen.

De synchronisatie tijdens het verloop van een gesprek, de onderlinge afstemming van de partners op elkaar, verloopt voor een belangrijk deel via het uitwisselen van blikken. Als gesprekspartners geven we elkaar signalen waarmee we de verdeling van de gesprekstijd regelen. Het zien van een hoofdknik, bijvoorbeeld, betekent toestemming om door te praten. Hoewel ook andere signalen een rol spelen, vormt de uitwisseling van blikken het belangrijkste hulpmiddel. Het aankijken is misschien wel ons belangrijkste non-verbale communicatiemiddel.

In de veelheid van gegevens die ons dagelijks passeert, zijn we voortdurend bezig met selecteren, filteren en ordenen. We zijn er beter in dan computers, vooral als de gegevens visueel voorgesteld worden. Een belangrijke functie van ons brein is patroonherkenning. Kunnen we verbanden ontdekken in de informatie die ons bereikt? Het kunnen herkennen van patronen vergrootte de kans op overleven voor de mens in de oertijd. Als het bijvoorbeeld enkele dagen achter elkaar regende, wisten onze voorouders dat de regentijd was aangebroken, en dat het tijd werd ergens anders heen te gaan.

Bijvoorbeeld in films verbinden wij als kijker de blikken en gezichtsuitdrukkingen van acteurs en actrices aan het verhaal. Ik vind het vooral fascinerend hoe één wenkbrauw beweging een verhaal verteld en dat de meeste mensen dat begrijpt. Zo las ik uit nogmaals uit mijn filmgeschiedenisboeken dat er voor 1910 amper gebruik werd gemaakt van close-up shots, shots die volop het gezicht in beeld hebben van mond tot wenkbrauwen. Later werd er volop gebruik van gemaakt om emoties over te brengen. De patronen uit de film zijn emoties en het gevoel wat zich de film vormt. Daar wordt in films gretig gebruik van gemaakt. Vaak onderscheiden wij niet alleen het niveau van acteren door middel van het uitspreken van een dialoog, maar ook de gezichtsuitdrukkingen en gelaatexpressies. Hoe natuurlijker, hoe realistischer.

Als maker vind ik dat we niet bewust zijn van het feit dat gezichtsuitdrukkingen verhalend er echter iets toe doen om films te versterken en waar de vormgeving, naast alle technische post-productie, zijn aandeel aan heeft. Elke film heeft zo zijn ingezette gezichtsuitdrukkingen om gevoel, emoties maar ook een stempel te geven aan de film. Er zijn gezichtsuitdrukkingen die bij de kijker bekend staan aan een film.

NIEUWE TECHNIEKEN

Naast dat wij over een paar jaar begroet zullen worden bij onze naam wanneer we binnenlopen in een kledingwinkel (gezichtsherkenning), worden de technieken voor het analyseren van emoties met de dag alleen maar beter. Het is niet zo gek idee als je je auto niet zou kunnen starten als je kwaad/emotioneel bent om ongelukken te voorkomen in het verkeer. Over een paar jaar vinden we de nieuwe technieken heel normaal.

Als het mogelijk is om zonder ‘woorden van betekenis’ bij mensen emoties te herkennen, zouden we dat dan machines kunnen laten doen? Het zou wel heel handig zijn. Stel, dat de TV, mobiele telefoon, beveiligingscamera, of misschien zelfs huisrobot, emoties herkent en daarop reageert. Waarschijnlijk zou het dan makkelijker met die apparaten kunnen werken, omdat ze u beter ‘begrijpen’. En wordt bijvoorbeeld elektronisch vergaderen veel effectiever. Of, herkennen we kwaadwillende passagiers in het openbaar vervoer eerder. Tal van toepassingen zijn mogelijk.

Psycholoog Paul Ekman heeft zich jarenlang beziggehouden met emotionele gezichtsuitdrukkingen. Hij definieerde een beperkt aantal basale veranderingen in het gezicht, die samenhangen met het samentrekken of ontspannen van gezichtsspieren. Hij noemt die veranderingen Action Units, waarmee alle emotionele gezichtsuitdrukkingen beschreven kunnen worden. De Roemeense Promovendus Dragos Datcu heeft deze theorie gebruikt om een toepassing voor automatische emotieherkenning te realiseren. Het doel van het onderzoek en het prototype is om de herkenning van emoties via gezichtsuitdrukkingen te combineren met die van emoties in stemgeluid. Vanuit de idee dat die combinatie machines rijkere informatie geeft voor een betere herkenning.

1. HOE JOU TOOL JOU VAK/BEZIGHEID DUIDELIJKER MAAKTE

Hoe kijken wij filmen, hoe kijken we er naar? Als kijker willen we alles kunnen verbinden met elkaar. Met gezichtsuitdrukkingen communiceren wij met gezicht ‘codes’. Een film met een goed verhaal zegt voor mij in ieder geval nog helemaal niks. Acteurs en actrices moeten het verhaal over kunnen brengen. De middelen die zij daarvoor hebben, naast het verbale spel (dialogen), zijn hun gezichtsuitdrukkingen waarmee zij emoties over kunnen brengen. Als een actrice of acteur daar geen kaas van heeft gegeten wordt het automatisch ongeloofwaardig. Daarom is het voor een filmregisseur van belang dat hij zijn actrices en acteurs goed kent om hen alleen maar te vertellen wat de situatie is in de scene die hij of zij moet ervaren.

Als we het hebben over saccadische patronen, dan blijkt het dat we met onze ogen verschillende bewegingen maken bij het waarnemen van een gezicht, object of iets elders. De oog springt van punt naar punt en hecht zicht aan details in plaats van iets in het totaal zich op te nemen. Zo zien wij een gezichtsuitdrukking in delen. We herkennen direct een gelaatexpressie van een emotie aan de ogen en mond.

De tool daagt de neutrale kijker uit om er achter te komen hoeveel een gezichtsuitdrukking kan doen om een filmscène te versterken of juist te verminderen op basis van geloofwaardigheid van het verhaal. De creatieve wisselwerking tussen denken en voelen probeer ik in zijn geheel bij de kijker neer te leggen. Het bewust worden van het feit dat de filmkijker naar een visueel verhaal kijkt wat bijna voor de helft non-verbaal wordt vertaald door middel van gezichtsuitdrukkingen.

Het ‘acteren’ is een vak apart. Als creatieveling zou ik het vak niet willen verstoren met technische elementen maar wel willen versterken met hulpmiddelen op het gebied van creatieve codering. Dit zou ik op de Digital Crafts wijze kunnen beoefenen.

2. CULTURELE CONTEXT VAN JE TOOL/OEFENING

Kyle McDonald, media vormgever, legde zijn gezichtsuitdrukkingen vast met Faceshift, een animatie software, door middel van een Kinect. In Faceshift liet hij zijn uitdrukkingen registreren en voorvertalen naar OSC. Daarmee stuurde hij zijn gezichtsuitdrukkingen naar MIDI poorten/kanalen. Wanneer hij verschillende gelaatexpressies voor de Kinect trok, maakte hij via Ableton geluid. McDonald deelt van dit project een tutorial via internet die ik heb kunnen uitvoeren.

Zo liet Jon afgelopen week een kunstwerk zien, Cinema Redux, van vormgever Brendan Dawes. In één opslag zie je in één vingerprint de hele film. Elk klein beeldje is een seconde frame uit de film. De frames achter elkaar maken er één visuele print van.

George Dunkley houd via zijn weblog ‘Movies in color’ verschillende film color palette’s bij waar op te zien is, uit één frame, welke kleuren een film bevat. Zo liet Dunkley bijvoorbeeld een frame zien uit de film ‘The Lift Aquatic With Steve Zissou’ waar vooral op te zien was dat regisseur Wes Anderson met de kleuren rood, geel en blauwe speelde. Het zegt eerlijk gezegd niets over de gehele film maar over het kleurgebruik van een shot uit een scene. Het staat visueel sterk in één print.

Ik vond een interessant project van kunstenaar Ben Grosser. Grosser wilde weten of er overeenkomsten waren tussen hoe wij naar films kijken en hoe een computer dat doet. Hij schreef software waarmee de computersysteem tijdens het kijken van films kon illustreren wat hij zag. In de software stopte hij reeks wiskundige berekeningen die over de vrijheden beschikte om zelf te bepalen wat belangrijk en onderscheidend is in elk afzonderlijk frame van een scène, zoals gezichten of gebouwen. Grosser stelt de kijker de vraag om hun eigen visuele herinnering te koppelen aan die van de computer. Hij heeft daarom beroemde filmscènes gebruikt uit 2001: A Space Odyssey, American Beauty, Inception, Taxi Driver, The Matrix en Annie Hall. De resultaten die er dan uit komen zien er uit als lijntekeningen die dan ook maar niks zeggen over de film zelf. Wanneer er wordt geschetst, speeld het geluid van de film af en zien we de computer in beeld schetsen. In de sleutelscène van Taxi Driver ("You talkin' to me?") praat hoofdrolspeler Trevis tegen zichzelf in een spiegel. Zeer imposant wanneer je de film ziet, maar de computer tekent enkele simpele lijnen. Per film levert dat allemaal verschillende tekeningen op. Grosser analyseert hiermee het verschil tussen de visie van computer en mens. Het heeft niet direct iets te maken met gezichtsuitdrukkingen maar het is wel een interessante hoek waar ik gelaatexpressies uit films kan belichten.

Een ander fascinerend project die ik had gevonden was het project van kunstenaar Sterling Crispin. Crispin maakte met behulp van een data bank vol met gezichten en sculpturen, die online staan, verschillende data-masks die hij vervolgens liet 3D printen. Crispin wilt met zijn serie data-masks ons waarschuwen voor onze privacy en vrijheid op het internet. Facebook analyseert bijvoorbeeld alle gezichten op van alle gebruikers die geregistreerd staan.

De tool die ik wil realiseren zou de kijker moeten beseffen hoe wij gezichtsuitdrukkingen kunnen gebruiken in het dagelijkse leven - want we communiceren niet alleen maar verbaal - en spelen ook een belangrijke rol om een film verhalend te ondersteunen en te versterken. Als filmmaker vind ik non-verbale communicatie zeer fascinerend in films. Een blik/gezichtsuitdrukking geeft zoveel sfeer en emotie mee aan de kijker. Er zijn voor mijn gevoel maar een aantal goede acteurs en actrices die gezichtsuitdrukkingen realistisch kunnen overbrengen. De Nederlandse film business staat vooral bekend om haar slechte acteerprestaties, voornamelijk verbaal - dialogen. In Nederland wordt de VSCD Mimeprijs uitgereikt aan acteurs of actrices die de belangrijkste bijdrage heeft geleverd aan mime in het betreffende seizoen. Het zijn acteurs en actrices die gezichtsuitdrukkingen en lichaamstaal goed gebruiken bij het acteren.

Research (English)

The easiest way to express our feelings is by means facial expression. It’s a way of communication that we use daily and where we have to deal with all the time. It reinforced and clarifies our story. Our emotions are firstly being read from our face and are shown unconsciously most of the time. To make feelings recocognizable to another person, it’s not only necessary that all humans use the same facial expression, persons need to recognize emotions by others.

The synchronization during the course of a conversation, the mutual tuning of partners between each other, is mainly and most importantly through the exchange of glance. As conversation partners, we give each other signals. We do this to regulate the distribution of the talk time between the two talkers. When you see a nod, for example, you are given a permission to talk. Although there are other signals play a role in the exchange of looks, it’s the most important tool. The look is perhaps our most important non-verbal communication.

During our daily lives, there are many data that will pass us. We are constantly engaged in selecting, filtering and sorting this information. We are better than computers, especially when the data is presented visually. An important function of our brain is pattern recognition. Can we find links between different kind of information that reaches us? The recognision of patterns increased the chances of survival for humans in prehistoric times. For example, if it rained many days in a row, our ancestors knew that the rain season came, and it was time to go somewhere else.

For example, in movies we connect, as a viewer, the looks and facial expressions of actors and actresses to the story. I fin dit especially fascinating how one eyebrow movement of an actor, tells a story that most people immediately understand. So I once again read from my film history books that before 1910, they were hardly using any close-up shots in film. Shots that mostly show the face full frontal, from the mouth till the eyebrows. Later in film history, they used it to convey emotions and it became an important tool to use in film, to show the viewer emotions. The pattern in the film are emotions and the feeling which forms the film. Nowadays this is used eagerly in mainly all films. Often we do not only distinguish the level of the acting work by dialogue, but also by facial expression and facial emotions. The more natural, the more realistic the film will be experienced by the viewer.

One of the characteristics of a good movie actor or actress is according to me good use of eyeplay, and the mimics. Yes, ofcourse the expression of the human face, especially in close up, gives us an ocean of meaning. By using different human facial expressions, it will have a big emotional power on the viewer. It’s the task of the director to find the perfect human expression in the face and body talk to a role, and mostly the casting agency finds the perfect actor for it.

As a maker, I think we are not aware of the fact that facial expressions have an important role in the film. It will make the film stronger, next to the design, and technical post production of a film. All those aspects will make or break the film. There are many facial expressions that will be so powerful, people will remind and connect it to the movie.

Besides that we are in a few years will be greeted by our name when we walk in a store (face recognision), the techniques for analyzing emotions will be better by day. It’s not a crazy idea to prevent you from driving a car when you’re angry or emotional to stop you from doing things you will regret later with the help of facial recognision. In a few years, we probably find these new techniques quite normal.

If it is possible to recognize without “words by meaning” and see the emotions with humans without words, is it possible to let machines do this? It would be really handy. Imagine the TV, your cell phone, security camera, or maybe even the house robot recognizing emotions and respond to this. You probably can work more efficient with these devices because they understand you better. Electronical conferences are more efficient, and maybe you can recognize malicious passengers at the public transport before anything bad happens. There are numerous applications possible, and they will probably be the future.

Psychologist Paul Ekman has for years been dealing with emotional facial expressions. He defined a limited number of basic changes in the face, associated with the contraction or relaxation of facial muscles. He calls these changes Action Units which all emotional facial expressions can be described. The Romanian PhD student Dragos Datcu used this theory to create an application for automatic emotion recognition. The purpose of the examination and the prototype is to combine the recognition of emotions over the facial expressions with those of emotions in voice. From the idea that giving combination machines richer information for better recognition.

How we watch film, how do we look at movies? As viewers we want to connect everything together. With facial expressions we communicate face 'codes'. A movie with a good story says, I think, in any case nothing at all . Actors and actresses should be able to bring the story. The resources they have had before, besides the verbal game (dialogues), their facial expressions in which they can bring certain emotions. When an actress or actor does not have the experience or does not bring the right expressions fitting to the role, you won’t believe the actor. Therefore, it’s important a film director knows his actresses and actors well enough to tell them just what the situation is in the scene that he or she has experienced and bring it to the screen.

When we talk about saccadic patterns, then it turns out that our eyes do different movements in the perception of a face, object, or something else. The eyes jumps from point to point to view details instead of something in total to take on. Thus we see a facial expression into parts. We immediately recognize a facial expression of emotion to the eyes and mouth.

The tool challenges the neutral viewer to figure out how a facial expression is enhancing a movie scene or just reduce on the basis of credibility of the story. The creative interaction between thinking and feeling I try to lay down in its entirety to the viewer. Becoming aware of the fact that the film viewer into a visual story that looks almost half nonverbal translated through facial expressions.

Acting is an art, not easy to learn or to understand. As a creative I would not want to disrupt the special things you can do with a human expression by using technical elements, but I like to reinforce it by using techniques and tools in the field of creative coding. This is according to me a great wat to practice the Digital Crafts and use them.

Kyle McDonald, media designer, used and locked his facial expressions in FaceShift, an animation software, by using a Kinect. In Face Shift he registered his expressions and translate to OSC . Thus he sent his facial expressions to MIDI ports / channels. When he pulled different facial expressions for the Kinect , he made via Ableton sound. McDonald shared this project and made a tutorial on the internet, which I used.

Jon showed me an artwork last week, Cinema Redux , by designer Brendan Dawes. In one view you see a finger print of the entire film. Every little statuette is a second frame from the movie. The frames placed behind each others make one visual print.

George Dunkley shows through his weblog 'Movies in color' different color palette at various films which show is one frame that contains a color film. So let Dunkley example show a frame from the film 'The Elevator Aquatic With Steve Zissou" where was mostly seen that director Wes Anderson mainly works with the colors red, yellow and blue. It says frankly nothing about the entire movie , but the color of a shot from a scene. It makes a movie visually much stronger by using one color palette and is strongly shown in one print.

I found an interesting project by artist Ben Grosser. Grosser wanted to know if there were similarities between how we watch movies and how a computer does. He wrote software that allows the computer while watching movies, he could illustrate what he saw. In the software, he used mathematical calculations that were able to determine what is important and distinctive in each frame of a scene, such as faces or buildings. Grosser allows the viewer to link their own visual memory, and compare it to the important things the computer found. He therefore used famous movie scenes from 2001: A Space Odyssey , American Beauty, Inception, Taxi Driver, The Matrix and Annie Hall . The results then get out there and look like line drawings but they also say nothing about the film itself. When there will be sketched, they played the sound of the movie and we see different sketches on the computer screen. In the key scene from Taxi Driver ("You talkin 'to me ?") Trevis, the main actor, talks to himself in a mirror. Very impressive when you see the film, but the computer just draws a few simple lines . Grosser analyzes the difference between the vision of computer and human. It does not have anything to do directly with facial expressions but it's an interesting angle where I can highlight films from facial expressions .

Another fascinating project that I found was the project of artist Sterling Crispin . Crispin used a data bank full of faces and sculptures, which you can find online, various data masks which he then showed 3D printing. Crispin shows with his series data masks that warn us of our privacy and freedom on the Internet. Facebook for example analyzes all faces of all users who are registered.

The tool that I want to show the viewer, is a realization and understanding how we can use facial expressions in everyday life - we communicate not only verbally - and also play an important role to support a film narrative and strengthen. As a filmmaker, I think nonverbal communication is very fascinating in movies. A look / expression gives so much atmosphere and emotion involved in the viewer. There are, in my mind, only a few good actors and actresses who can convey realistic facial expressions. The Dutch film industry is known for its poor performances, mainly verbal - dialogues. In the Netherlands the VSCD Mime Prize is awarded to actors or actresses that gives the most important contribution to mime in the season. They are all actors and actresses that use great facial expressions and body language in an excellent way when acting.